El año de los agentes (¿o no?)

Qué pueden hacer, por qué aún no despegan, y qué se necesita para llevar a producción a los agentes de IA

En el mundo de la IA, se empieza a imponer un cierto consenso: este será el año de los agentes. Pero hasta qué punto está la tecnología madura para que esto pase?

Vayamos por partes.

En primer lugar: un agente de IA es un sistema capaz de percibir su entorno, tomar decisiones y ejecutar acciones de forma autónoma para alcanzar un objetivo determinado. A diferencia de los modelos tradicionales de IA generativa, que responden a instrucciones individuales, un agente combina planificación, memoria, razonamiento y ejecución encadenada de tareas.

Puede interactuar con aplicaciones, navegar por internet, tomar decisiones condicionales o incluso colaborar con otros agentes. En teoría, actúa más como un colaborador digital que como un simple asistente conversacional.

Esta es la teoría. Y también hay algunas demos, como la que comenté en este post, donde la gente de Google hace una demo impresionante, combinando varias tecnologías perfectamente integradas en una experiencia natural y que es realmente útil.

Pero de momento, es una demo.

Y ahí vienen los escépticos: afirman que ni la tecnología está madura, ni es resistente a errores acumulativos en ciclos largos de decisión, ni será tan simple pasar de una demo a un sistema en producción que funcione de forma fiable y verificable en entornos reales.

Se podría argumentar que el hype en torno a los agentes no es casual. Grandes empresas tecnológicas y startups están invirtiendo miles de millones en posicionarse como referentes de esta nueva frontera, alimentando la narrativa de que estamos a las puertas de una revolución productiva. Pero detrás del entusiasmo hay muchos intereses: capital riesgo, presión por diferenciarse en el mercado y la promesa de una nueva interfaz universal basada en lenguaje natural.

El problema es que las dificultades técnicas son notables: los agentes actuales aún carecen de memoria fiable, de sentido común robusto y de mecanismos de verificación que permitan confiar en decisiones encadenadas. A eso se suma el reto de orquestarlos en entornos reales, con errores acumulativos y dependencia de modelos que no fueron diseñados para razonamiento persistente.

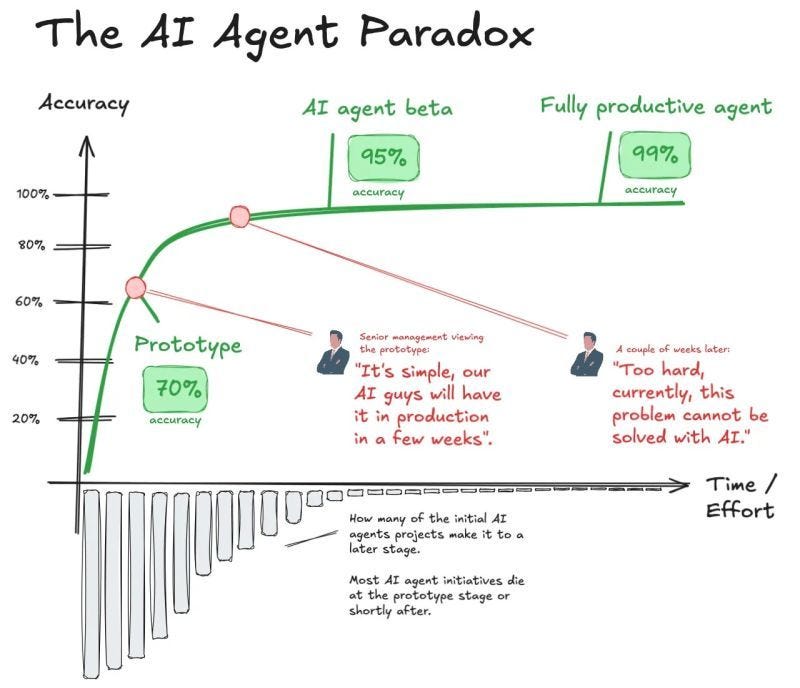

Todo esto lleva a que el incremento de precisión tiene su asíntota horizontal, tal y como se ve en la imagen inferior (vista en un post de Martí Domingo). Con un esfuerzo relativamente bajo se llega a porcentajes muy interesantes, lo que hace pensar que la perfección está cerca… pero cada vez cuesta más conseguir mejoras, lo que lleva en la mayoría de casos al abandono de los proyectos.

Mucha demo y mucho piloto, pero poca producción. Es lo que a veces llamamos en broma la “pilot-itis”.

A mi me sigue pareciendo que llega la hora de los agentes, y que su potencialidad es brutal. Pero también es cierto que todavía no vemos grandes implementaciones masivas.

Sólo el tiempo dirá si los agentes llegarán en el corto o el largo plazo. Pero yo creo que, sin duda, llegarán.

Coincideixo 100% Pep! I crec que no som massa lluny i que el seu desplegament comportarà canvis profunds en molts sectors, fins i tot a nivell de model de negoci (almenys al meu sector, el legal, farà estralls). Temps al temps! M’encanta la paraula ‘pilot-itis’ 😂😂 És que és tal qual!!!

"Y, cuando todo eso funcione, todavía queda convencer a legal, seguridad y al CFO."

Se nos olvida muchas veces esto, que son personas lo que hay detrás de todo, con sus sesgos y motivaciones